¿Go-Go-Gadget-Identidad Falsa?

¿Recuerdas al Inspector Gadget? Ese detective torpe que tenía un artilugio para todo, pero cuya tecnología siempre terminaba golpeándolo en la cara mientras su sobrina Penny (la verdadera experta) resolvía el caso en las sombras. Bueno, bienvenidos a enero de 2026. Hoy, los departamentos de TI y Finanzas de las empresas en Chile se sienten un poco como el Inspector Gadget: llenos de herramientas, pero totalmente superados por una tecnología que parece tener vida propia.

El pasado 13 de enero, Experian soltó una bomba en su reporte anual: el fraude ha dejado de ser un tipo en un sótano intentando adivinar tu contraseña. Hemos entrado oficialmente en la era del “Machine-to-Machine Mayhem” (Caos de Máquina a Máquina). Y créeme, esto no se arregla instalando un antivirus.

El Escenario: Robots Peleando en el Barro Digital

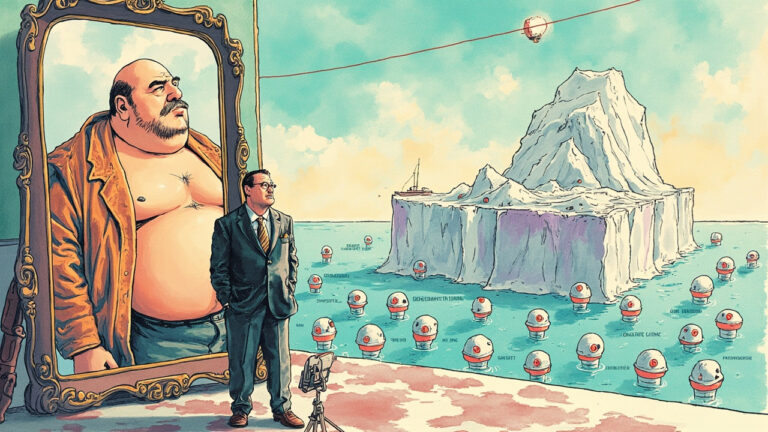

Imagina que tienes una tienda online o una fintech en Santiago. Hasta el año pasado, te preocupaba que alguien clonara una tarjeta o hiciera phishing. Eso es historia antigua. Según el reporte Future of Fraud Forecast 2026, los estafadores ya no operan manualmente. Ahora despliegan Agentes de IA Adversarios.

Estos no son scripts básicos. Son programas autónomos que hablan con tus APIs bancarias, prueban millones de identidades y ejecutan transacciones fraudulentas a velocidades que ningún humano puede monitorear. Es una guerra de desgaste: tu Agente de IA de Atención al Cliente contra el Agente de IA del Estafador. Y aquí entra el limbo legal que menciona Experian: si un robot estafa a otro robot, ¿quién paga la cuenta en pesos chilenos? ¿Tú? ¿El banco? ¿El desarrollador del software?

La Pesadilla de RRHH: “Contraté a un Fantasma”

Pero aquí viene la parte que realmente me quitó el sueño (y que debería preocupar a cualquier fundador que esté contratando talento remoto). El vector de ataque ya no es solo romper el firewall; es entrar por la puerta principal con una sonrisa.

El fenómeno se llama “Deepfakes Outsmart HR”. Funciona así:

- Paso 1: Una IA Generativa crea un CV perfecto, diseñado específicamente para burlar tus filtros automáticos (ATS).

- Paso 2: El candidato se presenta a la entrevista por Zoom o Teams. Se ve bien, habla bien, parpadea.

- Paso 3: Lo contratas. Le das acceso al VPN, al Slack y a los repositorios de código.

La realidad: Esa persona no existe. Era un video generado en tiempo real (Deepfake) suplantando una identidad. Una vez dentro, el “actor malicioso” (o su bot) exfiltra datos sensibles desde las entrañas de tu empresa. Ya no necesitan hackearte; tú les diste las llaves.

La Solución: Dejar de Validar Datos, Empezar a Validar Comportamiento

Aquí es donde entra mi rol de Arquitecta. No podemos pelear contra misiles con piedras. Si el enemigo usa IA, nosotros necesitamos IA Defensiva. La alianza anunciada el 15 de enero entre Feedzai y Matrix USA nos da la pista clave: la validación estática ha muerto.

Pedir una foto del carnet de identidad o preguntar el nombre de la primera mascota es inútil; la IA del estafador ya tiene esos datos. La nueva defensa es la Validación de Comportamiento Continua. ¿Cómo mueve el mouse el usuario? ¿A qué velocidad teclea? ¿Navega como un humano cansado o como un script perfecto? Necesitamos sistemas que detecten la humanidad, no solo la identidad.

Herramienta Práctica: El Protocolo “Anti-Gadget” para Entrevistas

Sé que implementar RiskOps avanzado toma tiempo y presupuesto. Pero si tienes entrevistas programadas para mañana, necesitas protección YA. He diseñado este protocolo táctico para “romper” la ilusión de un Deepfake durante una videollamada. Los deepfakes actuales, aunque avanzados, sufren con la oclusión y los movimientos rápidos impredecibles.

🛠️ Protocolo de Verificación Humana para RRHH (Versión 2026)

Instruye a tus reclutadores para aplicar estas 3 pruebas sutiles durante los primeros 5 minutos de la videollamada:

1. La Prueba de la Oclusión (El “Tápate la Cara”):

“Disculpa, el audio se cortó un segundo. ¿Podrías taparte la boca con la mano un momento y seguir hablando para ver si es mi micrófono?”

👉 Por qué funciona: Los modelos de Deepfake suelen fallar o generar “glitches” (parpadeos digitales) cuando un objeto físico (la mano) cruza por delante de la cara generada digitalmente.2. La Prueba del Perfil Lateral:

“¿Podrías girar la cabeza totalmente hacia la izquierda y mirar hacia esa pared un segundo? Quiero chequear la iluminación.”

👉 Por qué funciona: La mayoría de los modelos están entrenados con caras frontales. Los perfiles extremos (90 grados) a menudo hacen que la máscara digital se desprenda o se deforme en el cuello/orejas.3. La Pregunta Emocional Rápida:

Interrumpe con algo inesperado: “¡Rápido! ¿Qué desayunaste hoy?”

👉 Por qué funciona: Si es un bot de voz (text-to-speech) operado por un humano escribiendo respuestas, habrá un retraso (lag) antinatural. La reacción humana es inmediata, aunque sea para decir “ehhh… pan con palta”.

Tu Misión Ahora

El caos operativo de 2026 no se trata de tener más tecnología, se trata de tener la tecnología correcta. No seas el Inspector Gadget confiando ciegamente en herramientas que no entiendes. Asume que el fraude es autónomo y empieza a proteger tu activo más valioso: la confianza.

¿Estás listo para auditar tus procesos de contratación antes de que un “fantasma” entre en tu nómina? Si necesitas ayuda para diseñar flujos de trabajo que integren validación de identidad sin volver locos a tus empleados reales, aquí estoy para ayudarte a construir ese blueprint.