Tu operación necesita un “Quinto Elemento”

¿Recuerdas la película “El Quinto Elemento”? El caos amenaza al universo y la única salvación es la combinación de cuatro piedras elementales: Fuego, Agua, Tierra y Aire. Por separado, son solo rocas. Juntas, y activadas por el quinto elemento (Leeloo), salvan al mundo. Bueno, tu operación es exactamente igual. Tienes los “cuatro elementos” de datos: los logs de texto (Tierra), las alertas de sensores de temperatura (Fuego), las grabaciones de las cámaras de seguridad (Agua) y hasta el audio de una máquina que “suena raro” (Aire). El problema es que, al igual que en la película, están en silos. Son solo rocas de datos. Estás saltando de un dashboard de Power BI a un feed de video, tratando de conectar los puntos manualmente mientras el caos (el “apagar incendios”) te consume. Falta tu “Quinto Elemento”.

El Caos Actual: Ciegos y Sordos ante las Señales

Como Arquitecta de Soluciones, veo este caos todos los días. Gerentes de logística que tienen el video de un camión siendo cargado, pero deben ir a otro sistema (un Excel, probablemente) para verificar si el manifiesto de carga (texto) coincide. O jefes de planta en minería que reciben un dato de vibración (números) de una máquina crítica, pero no tienen cómo correlacionarlo con el sonido (audio) que el operador reportó hace una hora. Este es el caos de la “ceguera de datos”. Tienes toda la información, pero no tienes la visión. Estás reaccionando a los problemas porque no puedes ver (ni oír) las señales combinadas que predicen el fallo. Estás gestionando con los ojos vendados y los oídos tapados, confiando solo en el tacto (los reportes de texto).

Por Qué Tu IA Actual Solo Lee la Mitad del Guion

La explosión de los Modelos de Lenguaje Grandes (LLMs) como ChatGPT nos maravilló. De repente, la IA podía hablar. El problema es que nos enfocamos tanto en enseñarle a hablar, que olvidamos darle ojos y oídos. La mayoría de las implementaciones de IA en los negocios son “unimodales”: solo entienden texto. Pueden leer un email, resumir un reporte o analizar un log. Pero tu negocio no es solo texto. Tu negocio es físico. Es una caja en un estante (imagen), un motor vibrando (datos de sensor), un cliente hablando (audio) y una factura (texto). Depender solo de una IA de texto es como pedirle a un contador que pilote un avión de combate; está calificado, pero le falta el conjunto de habilidades (y sentidos) correcto para la tarea.

La Solución: El Agente “Leeloo” (El Orquestador Multimodal)

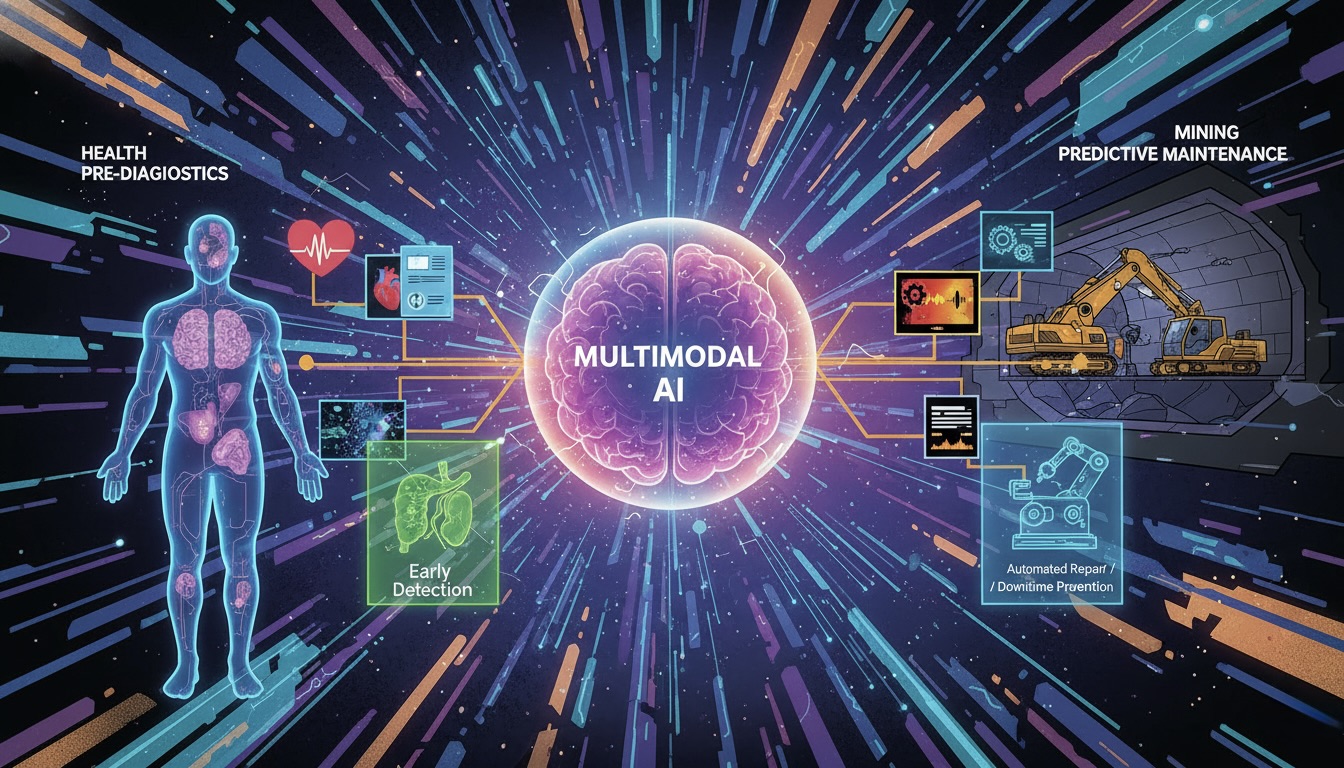

Aquí es donde entra la IA Multimodal. Esta no es una idea futurista; está pasando ahora y ya es rentable. La IA Multimodal es ese “Quinto Elemento”. Es un tipo de agente de IA que no solo procesa texto, sino que puede ingerir, entender y correlacionar múltiples tipos de datos simultáneamente. Es la IA que puede “ver” y “oír”.

Pensemos en los casos de la información base:

- Salud: Un agente multimodal no solo lee el historial clínico (texto). También “ve” la radiografía (imagen). Al fusionar esos dos elementos, puede sugerir un pre-diagnóstico con una precisión que ninguno de los dos datos por sí solo podría alcanzar. Puede decir: “Veo una opacidad en el pulmón izquierdo (imagen) que es consistente con la neumonía, y el historial del paciente (texto) menciona fiebre y tos seca, lo que aumenta la probabilidad al 95%”.

- Minería/Industria: Un agente multimodal no solo lee el log de fallos (texto). También “escucha” el audio de la máquina y “siente” sus datos de vibración. Puede decir: “El patrón de vibración (datos) ha aumentado un 15%, y el audio (sonido) muestra un chirrido de alta frecuencia que no estaba ayer. Cruzando esto con los logs (texto), predigo una falla del rodamiento 3B en las próximas 72 horas. Aquí está la orden de compra para la pieza”.

¿Ves el poder? Dejamos de reaccionar. Empezamos a predecir. La IA finalmente entiende la realidad física de tu operación.

Herramienta Práctica: El Blueprint del Agente de IA Multimodal

“Ok, Mariemily, suena genial. ¿Pero cómo empiezo? ¿Necesito un equipo de 50 PhDs?” No. Puedes empezar pequeño, pero necesitas la arquitectura correcta. Aquí está el blueprint básico que usamos para diseñar estos agentes. No es un prompt, es la receta.

Blueprint: Arquitectura de un Agente Multimodal Básico

Para construir tu “Quinto Elemento”, necesitas 4 componentes clave que trabajen juntos:

1. Los “Sentidos” (La Capa de Ingesta)

Es cómo el agente percibe el mundo. No necesitas construir esto de cero; usas APIs y modelos pre-entrenados:

- El Ojo (Visión): Un modelo de Visión por Computadora (CV). Puede ser algo como una API de Google Vision, AWS Rekognition, o un modelo open-source como YOLO. Su trabajo es mirar una imagen o video y decir: “Veo un casco”, “Detecto una grieta”, “Esta caja está dañada”.

- El Oído (Audio): Un modelo de procesamiento de audio. Puede analizar el espectrograma de un sonido y decir: “Esto es un motor funcionando normal”, “Esto es un chirrido anómalo”, “Esto es voz humana”.

- El Tacto (Datos/Sensores): Estos son tus datos estructurados. APIs que leen tus bases de datos, logs, sensores de IoT, etc.

2. El “Traductor Universal” (La Capa de Embeddings)

Aquí está la magia. No puedes simplemente “sumar” una imagen y un texto. Necesitas un traductor que convierta todo (imágenes, audio, texto, números) a un lenguaje común: los vectores. Cada “sentido” pasa su información por un modelo de embedding que lo convierte en una larga lista de números (un vector) que representa su significado.

3. El “Cerebro” (El Modelo Orquestador – LLM)

Aquí es donde entra tu LLM (como GPT-4o, Claude 3, o Gemini). Este es el cerebro que recibe todos esos vectores “traducidos”. Su trabajo no es solo procesar texto, sino razonar sobre las conexiones entre todos los datos. Le preguntas: “Analiza la producción de la última hora”. Y él internamente consulta a los otros componentes: “Ojo, ¿qué ves en la cámara de la línea 2? Oído, ¿qué escuchas de la máquina B? Tacto, ¿qué dicen los sensores de vibración?”.

4. La “Memoria” (La Base de Datos Vectorial)

El cerebro (LLM) necesita una memoria a largo plazo. Una base de datos vectorial (como Pinecone, ChromaDB, etc.) almacena todos los vectores traducidos. Esto permite al agente tener contexto. “Este sonido de máquina, ¿lo he oído antes? Sí, lo oí 3 días antes de que la Máquina A fallara el mes pasado”.

Cómo Aplicarlo Sin Romper el Banco

No intentes automatizar toda tu planta mañana. Empieza con un dolor. Uno solo.

- Identifica el “Caos de Silos”: ¿Dónde estás saltando entre dos pantallas para tomar una decisión? ¿Control de calidad (imagen vs. orden de compra)? ¿Mantenimiento (sonido vs. log)?

- Elige tus “Sentidos”: ¿Qué dos sentidos necesitas combinar? ¿Imagen + Texto? ¿Audio + Datos de Sensores?

- Prueba con APIs (Prueba de Concepto): Antes de construir nada, usa las APIs existentes. Envía tu imagen a la API de Vision y tu texto a la API de tu LLM. Pídele al LLM que compare los resultados en un solo prompt. Te sorprenderás de lo lejos que puedes llegar con esto.

- Construye el Blueprint: Una vez que la prueba de concepto funcione, usa el blueprint de arriba para diseñar una solución robusta.

Tu Operación te Está Hablando. ¿Estás Listo para Escuchar?

La IA multimodal no es el futuro; es la solución rentable a los problemas físicos de hoy. Es la diferencia entre apagar un incendio y evitar que comience. Tu operación te está enviando señales todo el tiempo a través de imágenes, sonidos y datos. El caos viene de no poder entenderlos todos juntos. Es hora de darle a tu negocio ese “Quinto Elemento”.

Como arquitecta, mi trabajo es construir el puente entre esos elementos. El tuyo, como líder, es decidir qué caos quieres resolver primero. ¿Qué “elementos” están separados en tu operación que, si se unieran, cambiarían el juego?