Piensa en una posibilidad hipotética en la que contratas a un sous-chef estrella Michelin para coordinar tu cocina. El tipo es brillante, conoce todas las técnicas y puede picar una cebolla con una precisión quirúrgica. Sin embargo, hay un problema: en el momento en que te das la vuelta para atender a un cliente, el chef olvida que el risotto estaba al fuego, confunde la sal con el azúcar porque alguien movió los frascos de lugar y, en lugar de avisarte que hay un incendio en la estación de pastas, se queda mirando la llama preguntándose filosóficamente por qué el fuego es caliente. Te pasas toda la noche supervisando cada movimiento, básicamente haciendo el trabajo de dos personas para que el plato llegue a la mesa.

Ese es exactamente el estado actual de la mayoría de las implementaciones de agentes de IA en las empresas. Hemos pasado la fase de “está increíble que pueda escribir un correo” y hemos entrado en el abismo operativo donde los modelos de propósito general, aunque potentes, sufren de una crisis de atención severa en cuanto el flujo de trabajo se extiende más allá de tres pasos. Se desvían, alucinan en mitad de una secuencia lógica y requieren que un humano (tú o tu equipo de IT) esté ahí, como un niñero digital, rescatándolos cada cinco minutos para que la tarea no termine en un desastre.

Ahora, entra en escena Claude Opus 4.7. Si el modelo anterior era el sous-chef talentoso pero distraído, el 4.7 es el Chef Ejecutivo que no solo conoce la receta, sino que gestiona la logística, anticipa que el proveedor de tomates llegará tarde y, si se corta la luz, sabe exactamente cómo terminar el servicio usando velas y creatividad sin entrar en pánico ni pedirte instrucciones paso a paso. No estamos hablando simplemente de un modelo “más inteligente” o que lee más tokens; estamos hablando de la consolidación de un sistema nervioso digital diseñado para la autonomía real. Anthropic no ha lanzado una actualización cosmética; ha cerrado la brecha entre la “capacidad de razonar” y la “capacidad de ejecutar y recuperarse”.

El fin de la “niñera de bots” y el salto al ROI real

Para quienes estamos en la trinchera de la arquitectura de soluciones, sabemos que el verdadero cuello de botella de la IA no es la latencia ni el costo por token —aunque mantener los precios en $5/M de entrada y $25/M de salida es un movimiento maestro de estabilidad para el presupuesto de cualquier C-Level— sino el costo oculto de la supervisión humana. Cuando un agente de IA falla en el paso 12 de un proceso de 15, el costo de retroceder, corregir y reiniciar anula cualquier ganancia de eficiencia.

Aquí es donde Opus 4.7 cambia las reglas del juego. Su arquitectura ha sido refinada desde mayo de 2025 para atacar el razonamiento multi-step y la recuperación autónoma. ¿Qué significa esto en lenguaje de negocio? Que si el modelo intenta ejecutar una API que devuelve un error 500, en lugar de detenerse y decir “lo siento, hubo un error”, Opus 4.7 analiza el error, hipotetiza la causa, ajusta la petición y vuelve a intentarlo. Es la diferencia entre un software que “estalla” y un sistema que “resuelve”.

Si miramos los números, la trayectoria es aterradora para la competencia. Con un 80,8% en SWE-bench Verified y un 65,4% en Terminal-Bench 2.0 ya en su versión 4.6, el salto al 4.7 no es solo una mejora en benchmarks, es una validación de que la IA puede manejar entornos de terminal y código con una autonomía que antes solo veíamos en demos manipuladas. Cuando tienes a gigantes como AWS, Apple, Microsoft, Google y JPMorganChase metidos en el Proyecto Glasswing, no es porque quieran jugar con un juguete nuevo; es porque necesitan proteger infraestructura crítica y software sensible con una fiabilidad que no permita errores. El Proyecto Glasswing es, esencialmente, el sello de garantía de que Opus 4.7 puede operar en el “mundo real” donde un error de lógica puede costar millones de dólares.

Más allá del chat: Un ecosistema de ejecución total

Lo que realmente me vuela la cabeza como arquitecta no es solo el modelo, sino cómo Anthropic está envolviendo ese cerebro en herramientas de ejecución. La rediseñada Claude Code ya no es un simple asistente de chat al lado del editor; es un IDE completo. Imagina que ya no escribes prompts para que la IA te sugiera código, sino que le das un objetivo de negocio —ej. “Refactoriza el módulo de pagos para soportar multi-moneda y optimiza la latencia de la base de datos en un 15%”— y el modelo navega por el repositorio, entiende las dependencias, aplica los cambios y ejecuta las pruebas unitarias por sí mismo.

Y para los que piensan que esto es solo para los “techies”, la nueva herramienta de diseño generativo que viene en camino es el golpe final. Al competir directamente con Adobe, Figma y Gamma, Anthropic está diciendo: “Podemos pensar la arquitectura, podemos escribir el código y podemos diseñar la interfaz”. Estamos pasando de la era de las “herramientas de IA” a la era de los “Sistemas Operativos de Autonomía”. Si puedes delegar la ingeniería, el diseño y la seguridad en un mismo ecosistema que mantiene el contexto y la coherencia, el ROI deja de ser una proyección en un Excel para convertirse en una realidad operativa inmediata.

El Playbook de la Autonomía Recurrente: Cómo implementar la “Auto-Corrección” hoy mismo

Sé que muchos de ustedes ya tienen agentes desplegados que “a veces funcionan y a veces se vuelven locos”. El problema suele ser que diseñamos flujos lineales: Paso A → Paso B → Paso C. Si el Paso B falla, el sistema muere. Para aprovechar la potencia de Opus 4.7, necesitas dejar de pensar en líneas y empezar a pensar en bucles de retroalimentación recursiva.

Aquí tienes el Framework de Orquestación de Recuperación Autónoma (FORA). No es un consejo genérico, es una estructura técnica que puedes implementar en tu capa de orquestación (ya sea usando LangGraph, CrewAI o una implementación propia) para maximizar el razonamiento de Opus 4.7.

La Arquitectura FORA: De la Linealidad al Bucle de Resolución

En lugar de un flujo simple, implementa un Nodo de Validación Crítica (NVC) después de cada acción compleja. El secreto no está en pedirle a la IA que “lo haga bien”, sino en obligarla a “criticar su propio resultado” antes de entregarlo.

El Prompt Maestro de Recuperación Recursiva (para Opus 4.7)

Copia y adapta este prompt en el sistema de tu agente cuando detectes una falla en la ejecución de una tarea:

“Actúa como un Ingeniero de Fiabilidad de Sistemas (SRE) Senior. Se ha detectado un fallo en el paso [X] del flujo de trabajo.

Entrada: [Input original]

Error detectado: [Log del error/salida inesperada]

Estado actual del contexto: [Variables actuales]Tu misión:

- Análisis de Causa Raíz (RCA): No intentes solucionar el problema aún. Primero, explica por qué falló la ejecución anterior en términos técnicos.

- Simulación de Solución: Propón tres caminos alternativos para resolver el error, evaluando el riesgo de cada uno.

- Ejecución Correctiva: Selecciona el camino de menor riesgo y ejecuta la acción.

- Verificación de Salida: Compara el resultado obtenido con el objetivo original. Si el resultado no es 100% coherente, reinicia este bucle recursivamente hasta alcanzar la resolución.

Restricción: No solicites intervención humana a menos que el error sea una limitación de permisos de infraestructura o un cambio en la definición del negocio.”

Pasos para ejecutar este abordaje “Out-of-the-box”:

- Mapeo de Puntos de Falla: Identifica en tu proceso actual dónde el agente suele “perder el hilo”. Esos son tus Nodos de Validación Crítica.

- Implementación del Bucle de Crítica: En lugar de que el agente pase al Paso C, haz que el resultado del Paso B pase por un “filtro de calidad” ejecutado por el mismo Opus 4.7 pero con el rol de SRE (como en el prompt anterior).

- Memoria de Error Local: Guarda los errores resueltos en una base de datos de vectores (RAG) a corto plazo. Así, si el agente encuentra el mismo error en otra rama del proceso, no tiene que razonarlo de nuevo, sino que recupera la solución exitosa anterior.

- Umbral de Escape: Define un máximo de 3 iteraciones recursivas. Si después de 3 intentos el SRE digital no lo resuelve, ahí y solo ahí, se dispara la alerta al humano. Esto reduce la intervención manual en un 70-80% en flujos complejos.

El horizonte de la ejecución sin supervisión

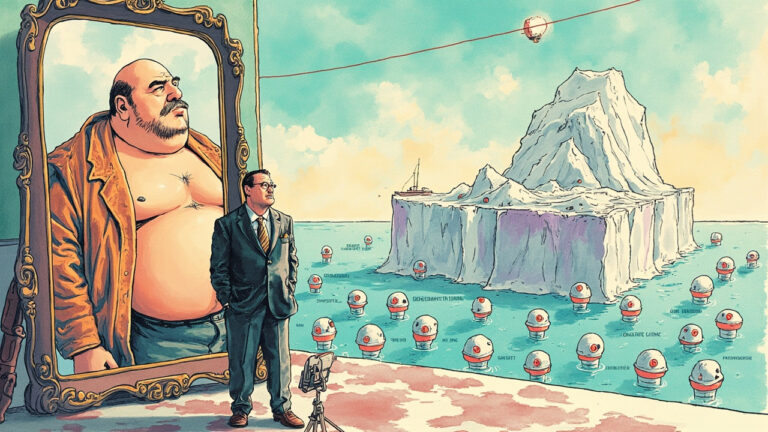

Estamos llegando a un punto de inflexión donde la pregunta ya no es “¿Puede la IA hacer esto?”, sino “¿Cuánto control estoy dispuesto a soltar?”. El lanzamiento de Opus 4.7 y el respaldo del Proyecto Glasswing nos indican que la industria ha dejado de buscar la “charla perfecta” para buscar la “ejecución perfecta”.

La verdadera ventaja competitiva en 2026 no la tendrá la empresa que tenga el modelo más grande, sino la que logre construir la infraestructura de orquestación más resiliente. Aquellos que sigan tratando a la IA como un chatbot avanzado seguirán siendo “niñeras de bots”, mientras que quienes adopten arquitecturas de recuperación autónoma y ecosistemas integrados como los de Anthropic, estarán operando a una escala que simplemente no requiere supervisión constante.

La capacidad de delegar flujos de trabajo extensos, desde la concepción del diseño hasta la implementación del código y su aseguramiento, sin que el sistema “se pierda en el camino”, es el Santo Grial de la automatización empresarial. Ya no estamos simulando inteligencia; estamos desplegando capacidad ejecutiva.

Ahora, te dejo con una reflexión que suele incomodar en las juntas de comité: Si tu arquitectura actual de IA todavía requiere que un humano valide el 30% de las salidas para evitar desastres operativos, ¿tienes realmente una solución de automatización o simplemente has digitalizado la microgestión?